本文使用的數據集是MNIST,主要使用兩個卷積層加一個全連接層構建的卷積神經網絡。

先載入MNIST數據集(手寫數字識別集),并創建默認的Interactive Session(在沒有指定回話對象的情況下運行變量)

|

1

2

3

4

|

from tensorflow.examples.tutorials.mnist import input_data import tensorflow as tf mnist = input_data.read_data_sets("MNIST_data/", one_hot=True) sess = tf.InteractiveSession() |

在定義一個初始化函數,因為卷積神經網絡有很多權重和偏置需要創建。

|

1

2

3

4

5

6

7

8

|

def weight_variable(shape): initial = tf.truncated_normal(shape, stddev=0.1)#給權重制造一些隨機的噪聲來打破完全對稱, return tf.Variable(initial) #使用relu,給偏置增加一些小正值0.1,用來避免死亡節點 def bias_variable(shape): initial = tf.constant(0.1, shape=shape) return tf.Variable(initial) |

卷積移動步長都是1代表會不遺漏的劃過圖片的每一個點,padding代表邊界處理方式,same表示給邊界加上padding讓卷積的輸出和輸入保持同樣的尺寸。

|

1

2

3

4

5

6

|

def conv2d(x,W):#2維卷積函數,x輸入,w是卷積的參數,strides代表卷積模板移動步長 return tf.nn.conv2d(x, W, strides=[1, 1, 1, 1], padding='SAME') def max_pool_2x2(x): return tf.nn.max_pool(x, ksize=[1, 2, 2, 1], strides=[1, 2, 2, 1], padding='SAME') |

在正式設計卷積神經網絡結構前,先定義輸入的placeholder(類似于c++的cin,要求用戶運行時輸入)。因為卷積神經網絡會利用到空間結構信息,因此需要將一維的輸入向量轉換為二維的圖片結構。同時因為只有一個顏色通道,所以最后尺寸為【-1, 28,28, 1],-1代表樣本數量不固定,1代表顏色通道的數量。

這里的tf.reshape是tensor變形函數。

|

1

2

3

|

x = tf.placeholder(tf.float32, [None, 784])# x 時特征 y_ = tf.placeholder(tf.float32, [None, 10])# y_時真實的label x_image = tf.reshape(x, [-1, 28, 28,1]) |

接下來定義第一個卷積層。

|

1

2

3

4

5

|

w_conv1 = weight_variable([5, 5, 1, 32])#代表卷積核尺寸為5X5,1個顏色通道,32個不同的卷積核,使用conv2d函數進行卷積操作, b_conv1 = bias_variable([32]) h_conv1 = tf.nn.relu(conv2d(x_image, w_conv1) + b_conv1) h_pool1 = max_pool_2x2(h_conv1) |

定義第二個卷積層,與第一個卷積層一樣,只不過卷積核的數量變成了64,即這層卷積會提取64種特征

|

1

2

3

4

|

w_conv2 = weight_variable([5, 5, 32, 64])#這層提取64種特征 b_conv2 = bias_variable([64]) h_conv2 = tf.nn.relu(conv2d(h_pool1, w_conv2) + b_conv2) h_pool2 = max_pool_2x2(h_conv2) |

經過兩次步長為2x2的最大池化,此時圖片尺寸變成了7x7,在使用tf.reshape函數,對第二個卷積層的輸出tensor進行變形,將其從二維轉為一維向量,在連接一個全連接層(隱含節點為1024),使用relu激活函數。

|

1

2

3

4

|

w_fc1 = weight_variable([7*7*64, 1024]) b_fc1 = bias_variable([1024]) h_pool2_flat = tf.reshape(h_pool2, [-1, 7*7*64]) h_fc1 = tf.nn.relu(tf.matmul(h_pool2_flat, w_fc1) + b_fc1) |

Dropout層:隨機丟棄一部分節點的數據來減輕過擬合。這里是通過一個placeholder傳入keep_prob比率來控制的。

|

1

2

3

4

5

6

7

8

|

#為了減輕過擬合,使用一個Dropout層 keep_prob = tf.placeholder(tf.float32) h_fc1_drop = tf.nn.dropout(h_fc1, keep_prob) #dropout層的輸出連接一個softmax層,得到最后的概率輸出 w_fc2 = weight_variable([1024, 10]) b_fc2 = bias_variable([10]) y_conv = tf.nn.softmax(tf.matmul(h_fc1_drop, w_fc2) + b_fc2) |

定義損失函數即評測準確率操作

|

1

2

3

4

5

6

7

|

#損失函數,并且定義優化器為Adam cross_entropy = tf.reduce_mean(-tf.reduce_sum(y_ * tf.log(y_conv), reduction_indices=[1])) train_step = tf.train.AdamOptimizer(1e-4).minimize(cross_entropy) correct_prediction = tf.equal(tf.argmax(y_conv, 1), tf.argmax(y_, 1)) accuracy = tf.reduce_mean(tf.cast(correct_prediction, tf.float32)) |

開始訓練

|

1

2

3

4

5

6

7

8

9

|

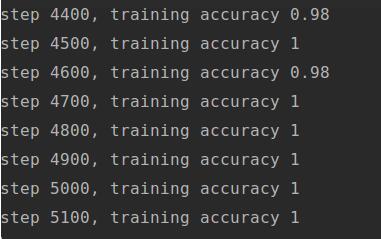

#初始化所有參數 tf.global_variables_initializer().run() for i in range (20000): batch = mnist.train.next_batch(50) if i%100 == 0: train_accuracy = accuracy.eval(feed_dict={x:batch[0], y_: batch[1], keep_prob: 1.0}) print("step %d, training accuracy %g"%(i, train_accuracy)) train_step.run(feed_dict={x: batch[0], y_: batch[1], keep_prob: 0.5}) |

全部訓練完成后,我們在最終的測試集上進行全面的測試,得到整體的分類準確率。

|

1

2

|

print("test accuracy %g" %accuracy.eval(feed_dict={ x: mnist.test.images, y_: mnist.test.labels, keep_prob: 1.0})) |

這個網絡,參與訓練的樣本數量總共為100萬,共進行20000次訓練迭代,使用大小為50的mini_batch。

因為我安裝的版本時CPU版的tensorflow,所以運行較慢,這個模型最終的準確性約為99.2%,基本可以滿足對手寫數字識別準確率的要求。

以上就是本文的全部內容,希望對大家的學習有所幫助,也希望大家多多支持服務器之家。

原文鏈接:https://blog.csdn.net/weixin_40533355/article/details/80418378